Yapay Zeka ve Makine Öğrenimi Uygulamalarında Güvenlik Açıkları

Yapay Zeka ve Makine Öğrenimi Güvenliği Nedir?

Yapay zeka (YZ) ve makine öğrenimi (MÖ) sistemleri, karmaşık kararlar alabilen ve verilerden öğrenebilen yapılar sunar. Bu sistemlerin güvenliği, hem modellerin hem de verilerin yetkisiz erişime, manipülasyona ve suistimale karşı korunmasını sağlayan teknik ve idari önlemleri kapsar. Güvenli bir YZ sistemi, hem geliştirme hem de uygulama aşamasında gizlilik, bütünlük ve erişilebilirlik ilkelere uygun olarak tasarlanmalıdır.

Yapay Zeka Güvenlik Riskleri

YZ sistemleri; model yanıltma, veri zehirleme, model sızdırma, öğrenilen bilgilerin açığa çıkması ve hatalı karar alma gibi çeşitli tehditlerle karşı karşıya kalabilir. Bu riskler, hem bireylerin mahremiyetine zarar verebilir hem de endüstriyel sistemlerin ciddi zararlara uğramasına neden olabilir.

Makine Öğrenimi Modellerinin Güvenlik Açıkları

ML modelleri, öğrenme verisinin kalitesine ve modelin yapısına bağlı olarak farklı zafiyetler barındırabilir. En sık rastlanan açıklar arasında adversarial örneklerle yanıltma, öğrenilen modelin tersine mühendislikle çözülmesi ve hassas bilgilerin sızdırılması yer alır.

Siber Güvenlik ve AI İlişkisi

YZ teknolojileri hem siber güvenlik için bir tehdit unsuru hem de bir savunma aracıdır. Bir yandan AI destekli siber saldırılar gelişirken, diğer yandan AI tabanlı güvenlik sistemleri (anomal tespiti, otomatik cevaplama sistemleri vb.) siber tehditlere karşı etkili çözümler sunmaktadır.

Yapay Zeka ve Makine Öğrenimi Güvenlik Açıkları

Adversarial Attacks

Adversarial saldırılar, modellerin karar alma süreçlerini bozan, bilinçli olarak tasarlanmış örneklerle yapılır. Görünürde zararsız olan bu veriler, modelin hatalı sınıflandırmalar yapmasına neden olabilir. Bu tür saldırılar özellikle görüntü işleme, doğal dil işleme ve ses tanıma gibi alanlarda çok etkilidir.

Model Zehirleme (Data Poisoning)

Model zehirleme, öğrenme verisi içerisine bilinçli olarak hatalı veya yanıltıcı verilerin eklenmesiyle modelin yanlış öğrenmesine neden olur. Bu teknik, modelin güncellenme süreçlerini hedef alarak uzun vadeli bozulmalar yaratabilir.

Model Çalma ve Tersine Mühendislik

Model çalma, sınırlı sayıda sorgu ile modelin davranışını analiz ederek benzer bir modelin yeniden oluşturulmasını içerir. Tersine mühendislik ise, model mimarisi ve parametrelerinin açığa çıkarılarak yetkisiz şekilde yeniden kullanılmasına olanak tanır.

Yanıltıcı Veri ve Güvenilirlik Sorunları

Veri kalitesindeki eksiklikler, önyargılı veya dengesiz veri kümesi kullanımı modellerin yanlış çıktılar vermesine neden olabilir. Bu durum hem karar mekanizmalarının hem de sistem güvenliğinin zafiyete uğramaması için kritik bir sorundur.

Yapay Zeka Destekli Siber Saldırılar

YZ, özellikle otomatik saldırı stratejileri, hedef analizleri ve zafiyet tespiti gibi alanlarda saldırganlara avantaj sağlamaktadır. Örneğin, sosyal mühendislik saldırıları için özelleştirilmiş phishing içerikleri YZ ile otomatik olarak oluşturulabilir.

Güvenlik Açıklarına Karşı Önlemler

Güvenli Veri Yönetimi

Veri anonimleştirme, şifreleme ve güvenli veri paylaşımı gibi teknikler, modelin öğrenme sürecinde kullanılan verilerin gizliliğini sağlamak için temel önlemlerdir.

Adversarial Attack’lere Karşı Savunma

Adversarial training, input filtering, model robustification gibi tekniklerle bu tür saldırılara karşı savunma geliştirilebilir. Ayrıca, test verisi üzerinde adversarial tespit sistemleri kullanmak da modelin savunmasını artırabilir.

Model Erişim Kontrolleri

Erişim kontrolleri; şifreleme, kimlik doğrulama ve rol tabanlı erişim yönetimi gibi yöntemlerle modellerin yetkisiz erişime karşı korunmasını sağlar.

Güvenli AI Geliştirme Süreçleri

Model geliştirme sürecinde tehdit modelleme, güvenli kodlama ilkeleri, test ve doğrulama süreçleri entegre edilmelidir. Tedarik zinciri güvenliği de bu sürecin bir parçası olmalıdır.

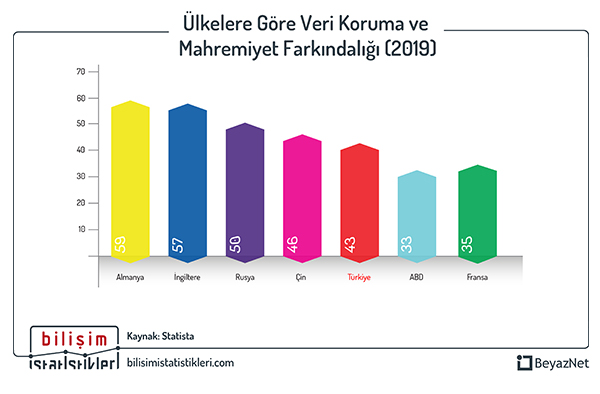

AI Regülasyonları ve Uyumluluk

GDPR, AI Act (AB) gibi yasal düzenlemeler, AI sistemlerinin etik, adil ve güvenli olması için bir çerçeve sunar. Bu standartlara uyum, uzun vadede hem yasal risklerin hem de teknik tehditlerin azaltılmasına katkı sağlar.

Yapay Zeka Güvenliğinin Geleceği

AI ve ML’de Yeni Güvenlik Tehditleri

Gelecekte, daha kompleks ve farklı senaryolar ile adversarial saldırılar, otonom sistemlerin manipülasyonu, ve çoklu model entegrasyonlarından kaynaklanan yeni tehditler ortaya çıkacaktır.

Yapay Zeka ile Güvenliğin Artırılması

YZ, tehdit algılama, şüpheli aktivite izleme ve otomatik yanıt sistemleri gibi alanlarda siber savunmanın temel bileşeni haline gelecektir.

AI Güvenliği İçin Yeni Çözümler

Federated learning, differential privacy, explainable AI gibi teknolojiler, daha şeffaf ve güvenli modellerin geliştirilmesine olanak sağlayacaktır.

Sıkça Sorulan Sorular (SSS)

Yapay zeka sistemleri neden saldırılara açıktır?

YZ sistemleri, veriye dayalı çalıştıkları için hem veri kalitesi hem de model yapısındaki zaaflardan etkilenebilir. Öğrenilen bilgiler üzerinden mantıksal çıkarımlarla sistemler suistimal edilebilir.

Makine öğrenimi modelleri nasıl manipüle edilebilir?

Adversarial örnekler ve data poisoning yöntemleri ile modeller yanlış kararlar almaya itilebilir. Bu saldırılar, modelin çıktılarını manipüle ederek sistemin güvenilirliğini azaltır.

AI güvenliği için hangi önlemler alınmalı?

Model geliştirme sürecinde güvenlik testleri, veri koruma tedbirleri, adversarial tespit sistemleri ve erişim kontrolleri uygulanmalıdır.

Model tersine mühendisliği nedir ve nasıl önlenir?

Tersine mühendislik, modelin davranışını analiz ederek yeniden oluşturulmasıdır. Bu tehdit, model sorgu limitleri, rate limiting ve şifreleme gibi tekniklerle azaltılabilir.

AI güvenliği için en iyi uygulamalar nelerdir?

Güvenli yazılım geliştirme, şeffaflık, test odaklı mimari, regülatif uyumluluk ve sürekli izleme gibi uygulamalar AI güvenliğini sağlamak için temel yaklaşımlardır. Bu yaklaşımları baz alarak karar vermek daha doğru bir seçim yapmaya olanak sağlayacaktır.

Yazar: Salih KAYA / BeyazNet Penetration Tester

.png)